A Nemzeti Média- és Hírközlési Hatóság a deepfake-jelenség társadalmi kockázatára hívja fel a figyelmet

A deepfake olyan, a hitelességét tekintve rendkívül meggyőző videó, amelyben általában emberek arcát felhasználva hamis képmásokat mutatnak be, melyeket mesterséges intelligencia felhasználásával állítottak elő. A fényképek retusálása, azaz technikai értelemben vett meghamisítása nem újkeletű gyakorlat, azonban a mesterséges intelligencia nemcsak a képek megváltoztatását, hanem azok létrehozását is lehetővé teszi. A deepfake-jelenség 2017-ben indult hódító útjára a Reddit fórumon, ahol az egyik felhasználó egy pornószínésznő arcát egy híres színésznőével helyettesítette. A videót követően számos hasonló hamisítvány látott napvilágot, és 2018 végére már szinte általánossá vált.

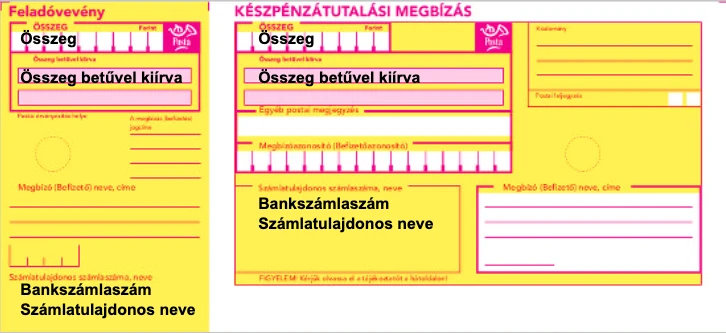

Ma már bárki tud jobb vagy rosszabb minőségben, különösebb utánajárás és technikai ismeret nélkül is deepfake tartalmakat készíteni. Az internetfelhasználók főként pornográfia hamisítására és mémek készítésére használták. A kifejezetten félrevezető céllal megalkotott, úgynevezett megtévesztő deepfake víziója is hamar megszületett. Az effajta tartalom hosszú ideig csak fikcióként élt a köztudatban. Az elméleti lehetőség azóta valósággá vált. Erről árulkodik az a 2022 júniusában történt magyarországi eset is, amely Budapest főpolgármesterhez, Karácsony Gergelyhez, valamint Kijev polgármesterhez, Vitalij Klicskóhoz kapcsolódott, pontosabban egy ál-Klicskóhoz, ugyanis – mint később kiderült – a budapesti főpolgármester a videóbeszélgetés során nem a hivatalban lévő ukrán városvezetővel folytatott beszélgetést. Karácsony és a hivatal dolgozói sokáig nem észlelték, hogy hamisítvánnyal van dolguk, mivel a deepfake Klicsko a háborút és a menekültválságot érintően releváns kérdéseket tett fel. Utólag kiderült, hogy az ál-Klicsko korábban Madrid, Berlin és Bécs polgármestereivel is kezdeményezett videóhívásokat. Nagy port kavart az a 2019-es eset is, amikor egy brit energiavállalat vezérigazgatójának hangját deepfake technológia segítségével reprodukálták, és a cég ügyvezető igazgatóját 200 ezer euró átutalására kérték fel egy állítólagos magyar beszállító javára. Mire az átverést felfedezték, a pénz, ami magyarországi, valamint mexikói számlákon mozgott, már szétszóródott a világban.

A deepfake és a törvényi szabályozás

A tapasztalatok szerint a hamisítványt legkönnyebben az apró részleteken keresztül tudjuk leleplezni. Léteznek ugyanis a deepfake-re jellemző tipikus hibák, melyek általános ismertetőjegyei az ilyen jellegű hamisítványoknak. Ha odafigyelünk ezekre, egy idő után már könnyebben felfedezhetjük, hogy nem egy valódi személyt látunk a felvételeken. Az első és legfontosabb, hogy jól szemügyre vegyük a képen vagy videófelvételen látható arcot, a pórusokat, a homlokot, kiváltképpen a haj és a nyak vonalát, hiszen számos esetben a hamisítvány már az illesztési pontokat követve leleplezhető. Bár a jelenlegi algoritmusok nagyon precízek, árulkodó nyom lehet, ha rendellenességet tapasztalunk a száj és a szemöldök mozgását figyelve.

A törvényi rendelkezések a deepfake létrejöttét elősegítő technológiát nem, de a felhasználásának módját már szabályozzák.

A deepfake algoritmussal létrehozott tartalmak viszonylag új jelenségnek számítanak, de a szakértők már felhívták a figyelmet arra, hogy milyen kockázatokat is jelenthetnek az egyénekre, szervezetekre vagy akár országok kormányaira nézve. Elsőre megdöbbentőnek hathat, de senki sincs biztonságban a deepfake-tartalmaktól. Egyes országokban már léteznek kifejezetten az ilyen tartalmakkal való visszaélések ellen létrehozott büntető szankciók, ugyanakkor a legtöbb helyen, ahogy hazánkban is, a jogi háttér még nem biztosított.

A deepfake-technológia által generált kép- és hanganyag jogszerű használata nagyszerű üzleti lehetőségeket kínál, valamint számos új kaput nyit ki a marketing, a televízió és a mozi számára szerte a világon. A technológia önmagában ártalmatlan és a konstruktív felhasználása nemcsak a különböző cégek és vállalatok érdekeit szolgálja, hanem jelentős társadalmi együtthatója révén, nagy hatással lehet az emberek életére.